AI/Linear Algebra, Math

[elice 머신러닝] 머신러닝을 위한 수학_벡터

Tashapark

2025. 3. 30. 21:42

728x90

*elice 코딩 강의안*

... 문과 수학에서 멈춰진 내가 할 수 있을까 싶지만 우선 들어본다.

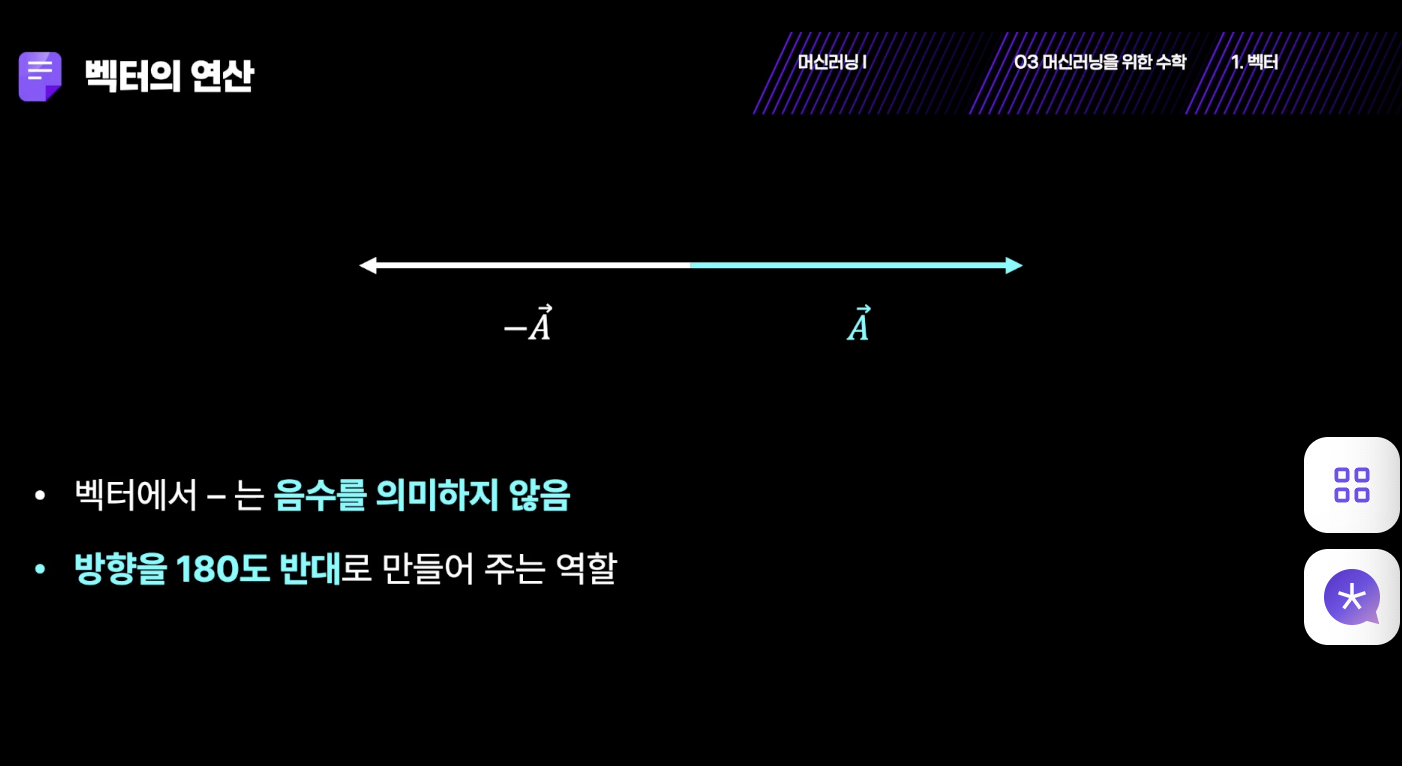

- 정반대 방향을 의미할 뿐

- 0으로 이루어져 있는 경우를 의미함.

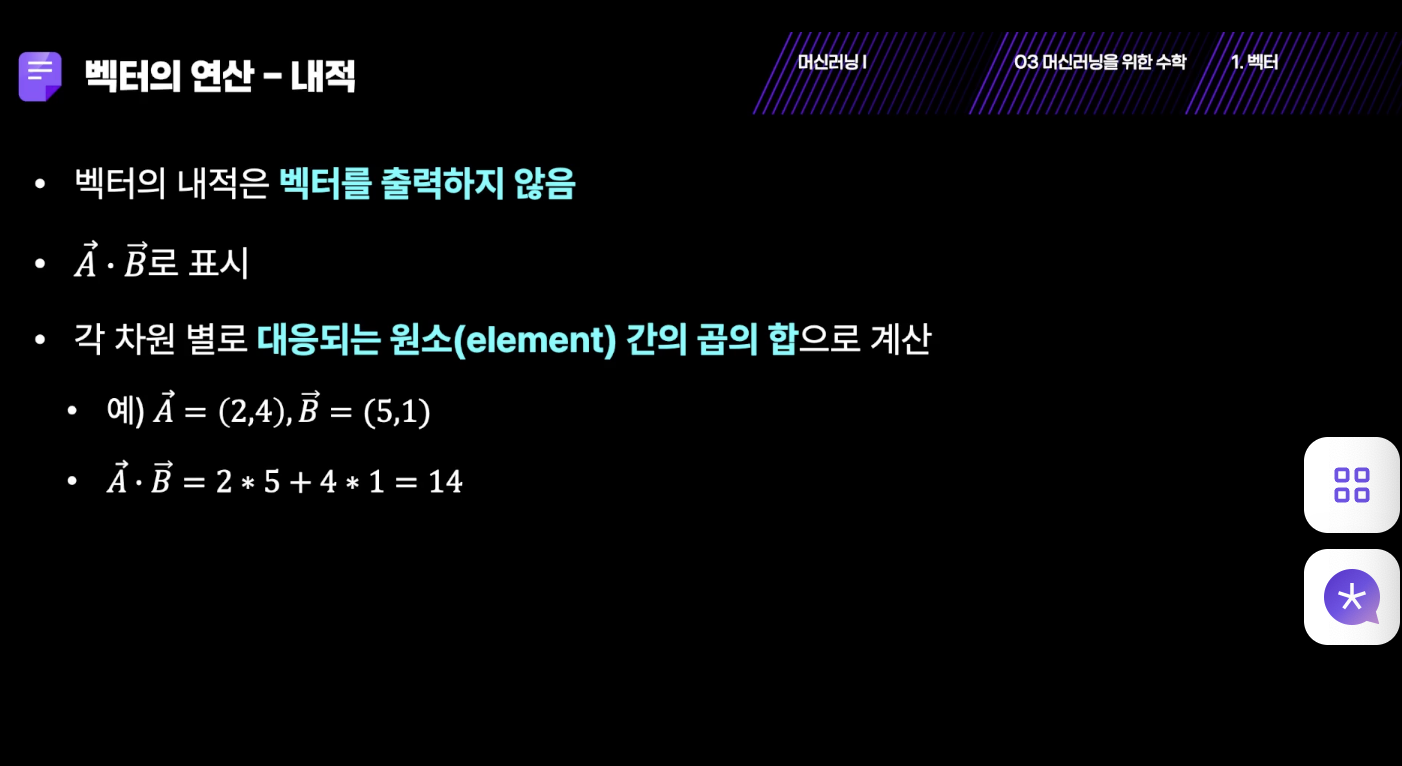

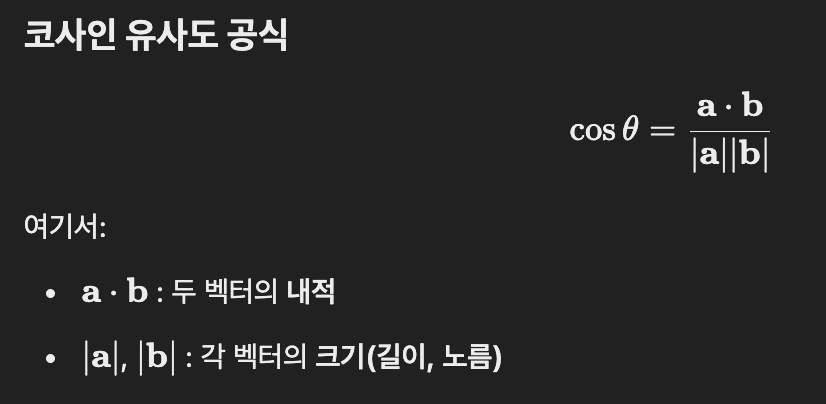

- 내적 inner product, dot product: 두 벡터의 곱셈 연산 중 하나로, 두 벡터가 얼마나 같은 방향을 향하는지 나타내는 값

- 같은 위치에 있는 원소끼리 곱한 후 다 더하는 연산임

- np.dot(a,b) 내적함수임.

- 내적을 하면 스칼라가 됌

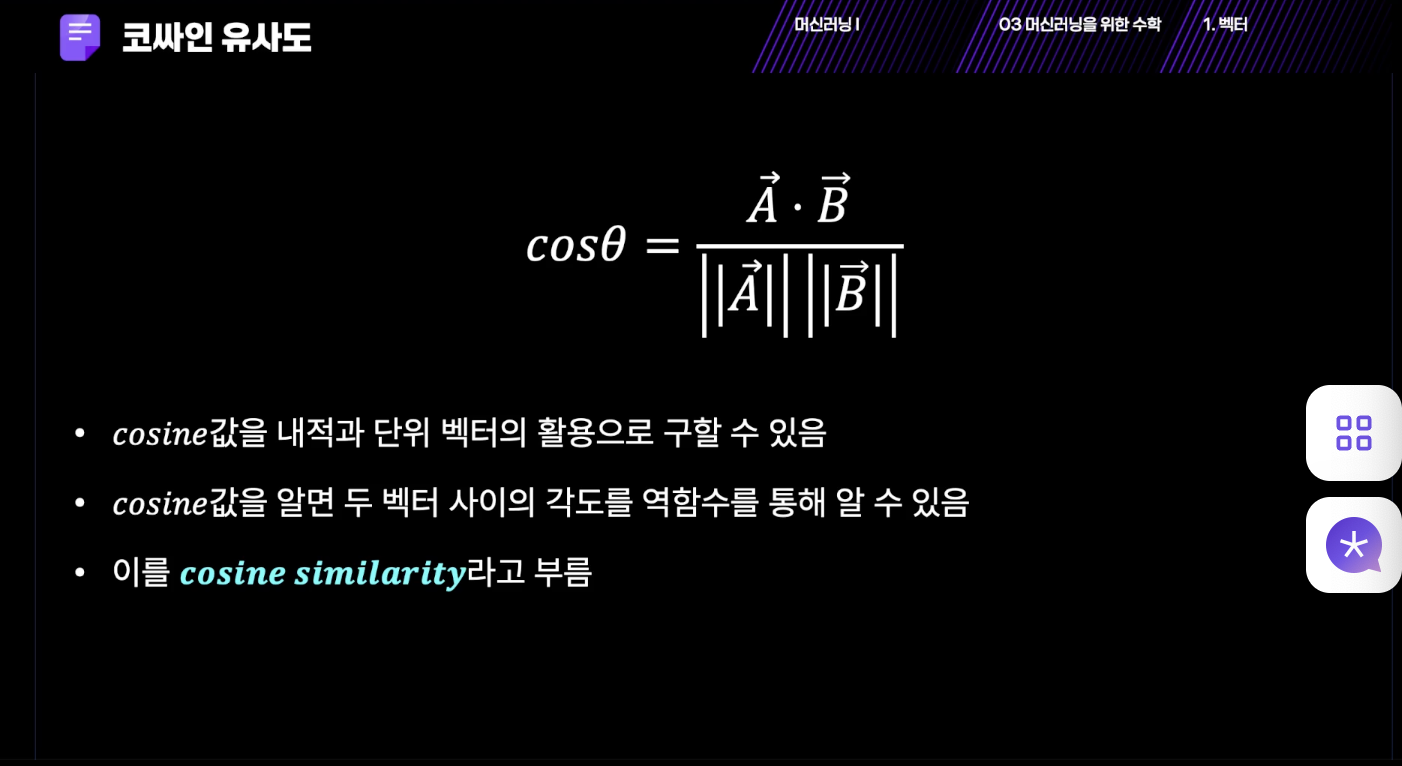

- 두 벡터 사이의 각도를 구할 수 있기에, 두 벡터가 연관된 건지 아닌 지를 알 수가 있음.

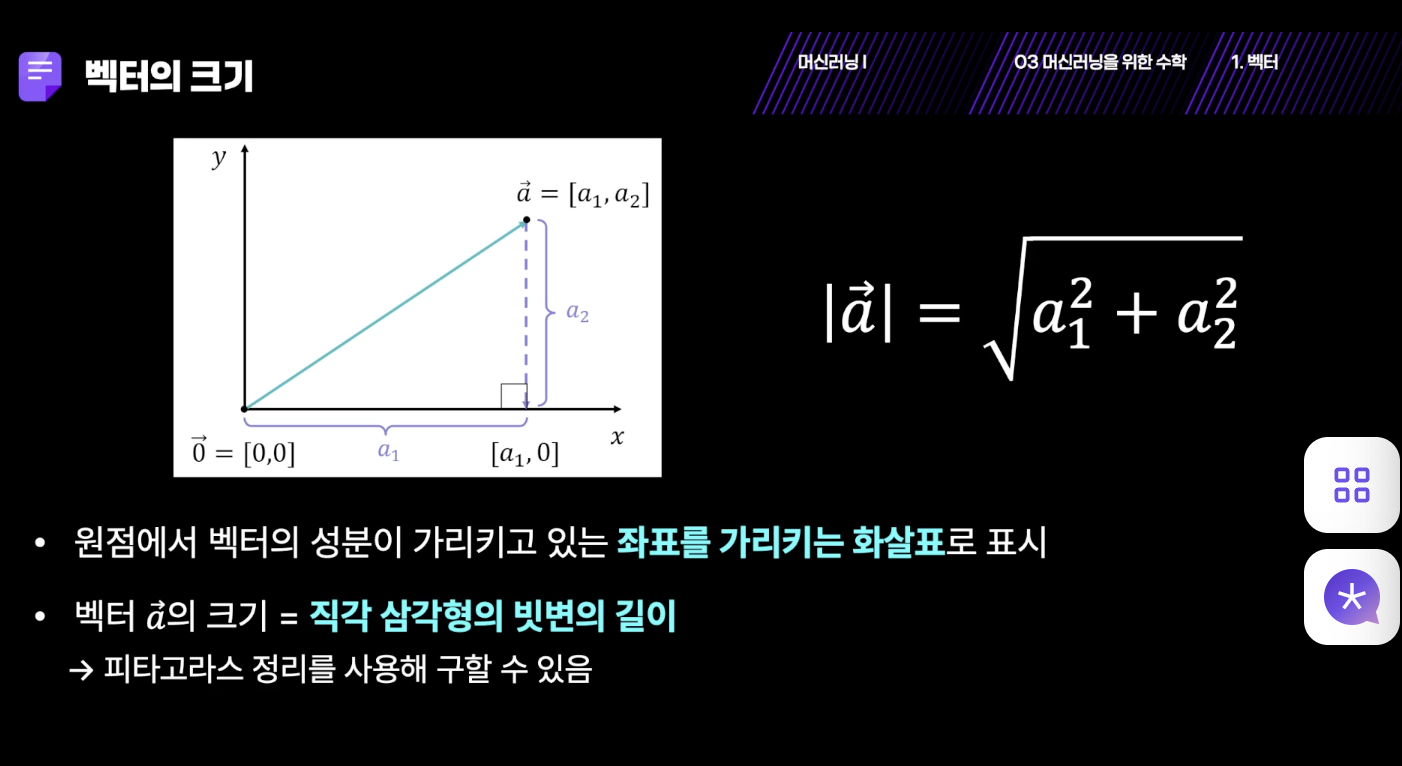

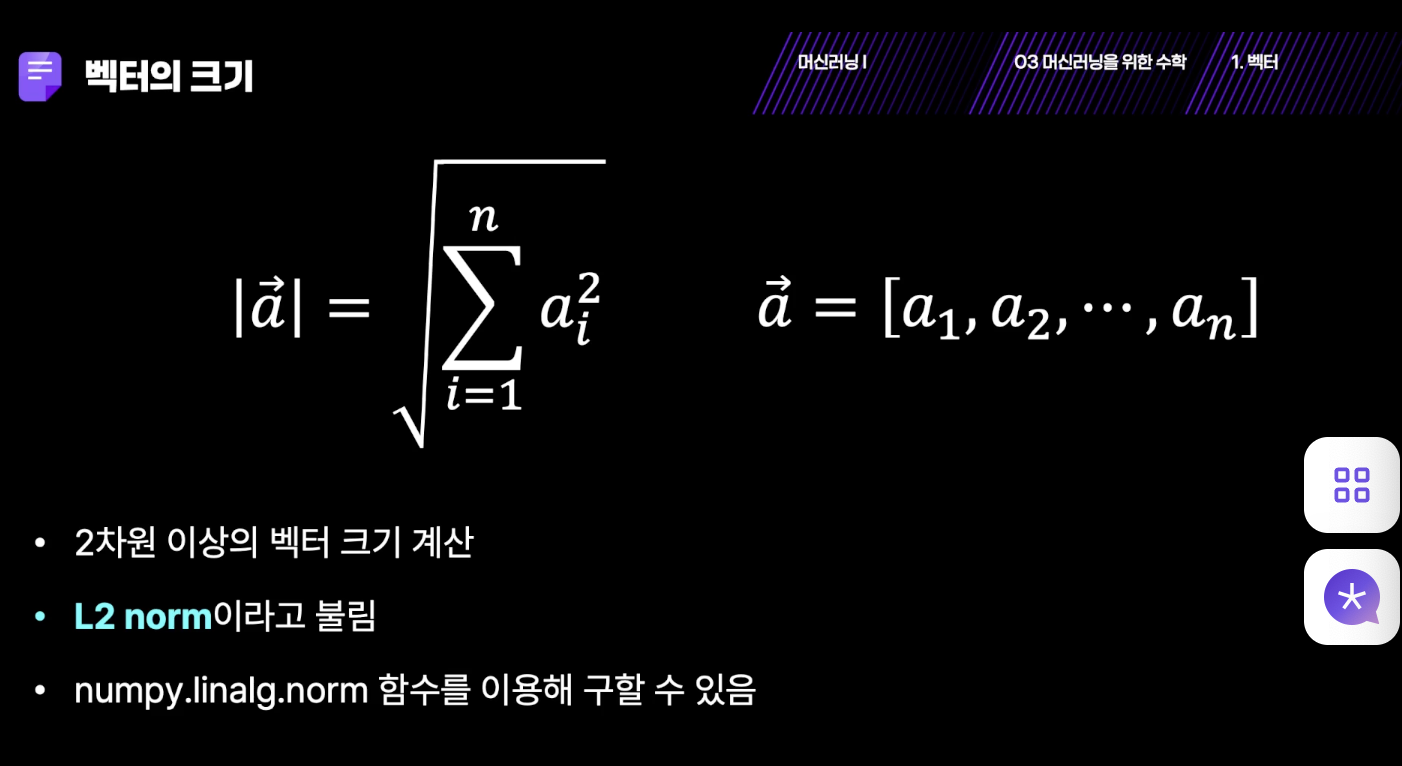

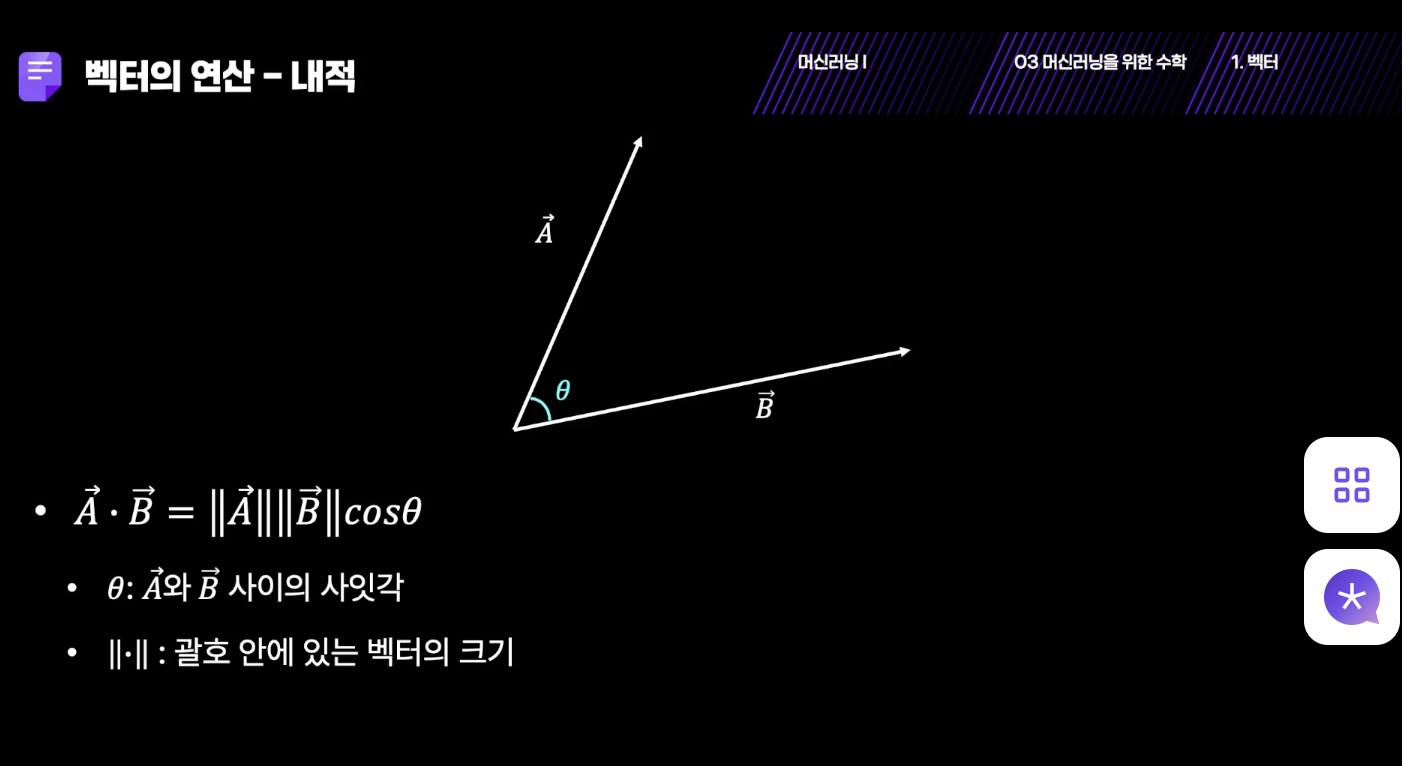

- , : 벡터의 크기(길이)

- : 두 벡터 사이의 각도

각도와의 관계

- → 내적이 양수 → 1에 가까울수록; 두 벡터가 비슷한 방향 => 연관성이 큼. ex. 행복, 기쁨

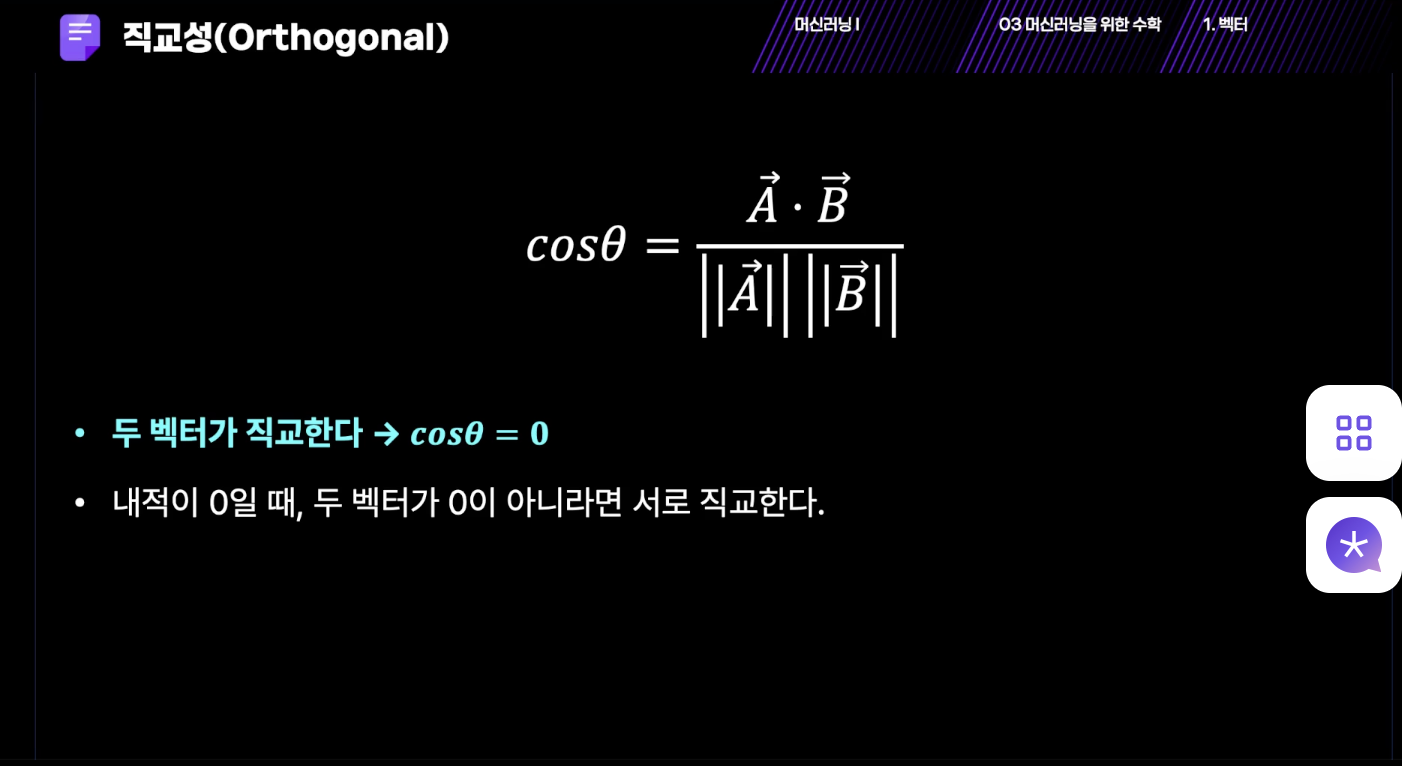

- → 내적이 0 → 두 벡터가 수직(직교) => 서로 독립적임. 완전히 무관함 ex. 사과, 행복

- → 내적이 음수 → -1에 가까울수록 ; 두 벡터가 반대 방향 => 연관성이 작음. ex. 위, 아래

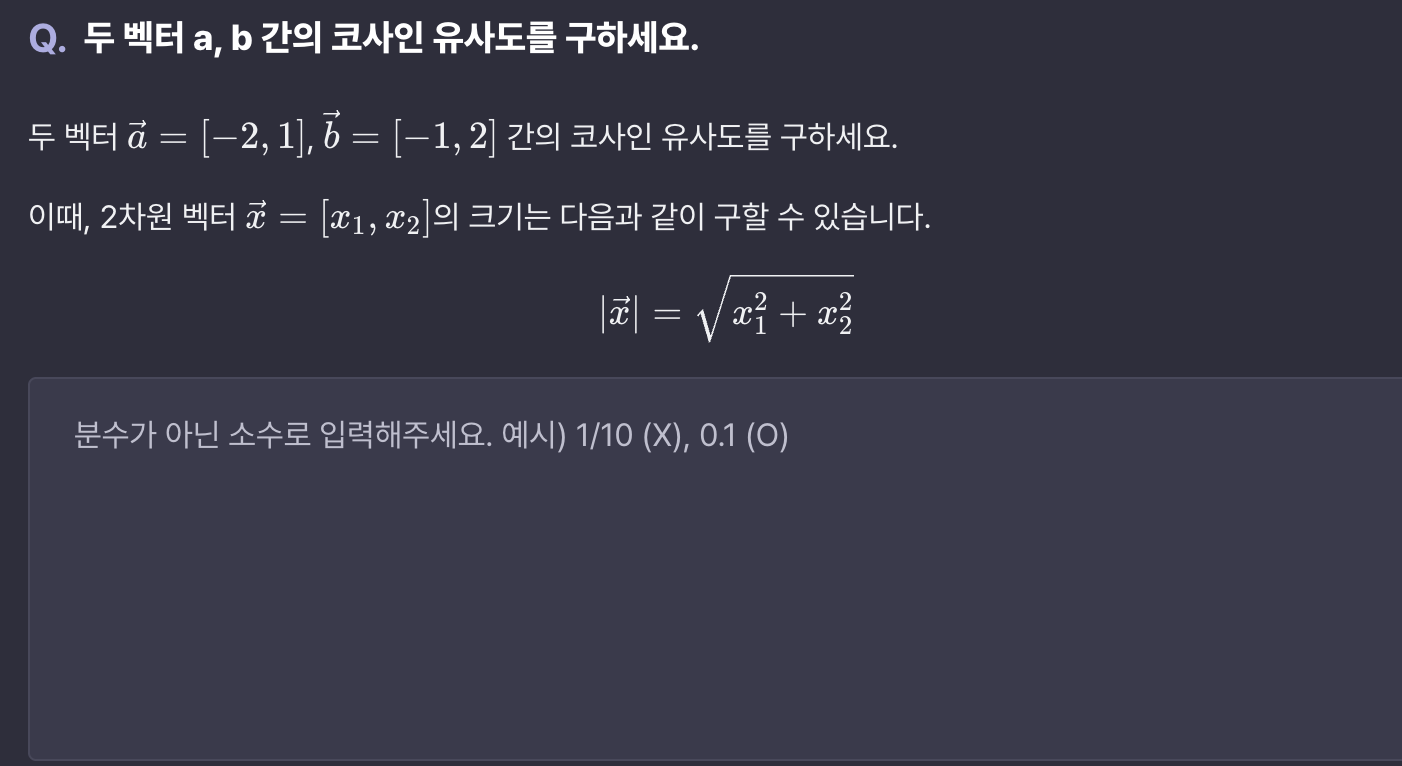

- 이 경우 두 벡터의 내적 / 각 벡터의 크기 (길이 , 노름)

- 내적= (-2*-1) + (1*2) =4

- 벡터 크기: 각각 피타고라스 빗변. 루트 5 * 루트 5 = 5

- 부호 상관없이 절대값으로 빗변 생각하면 됨

- 코사인 유사도: 4/5 = 0.8

- 직교 = 90도

728x90

반응형